- 웹진에 실린 글의 내용은 (재)예술경영지원센터의 의견과 다를 수 있습니다.

TEL 02-708-2293 FAX 02-708-2209 E-mail : weekly@gokams.or.kr

.jpg)

메타버스에서 공연하기 (Performing in the Metaverse)

XR극장 제작에서의 경험을 바탕으로(Lessons in Crafting XR Theatre) 글: 알렉스 쿨롬(Alex Coulombe)_ 헤브뉴(Heavenue) 대표, 에이질 렌즈(Agile lens) 크리에이티브디렉터

글: 알렉스 쿨롬(Alex Coulombe)_ 헤브뉴(Heavenue) 대표, 에이질 렌즈(Agile lens) 크리에이티브디렉터

예술경영 487호_2022.11.24.

예술경영 487호_2022.11.24.

본 원고는 지난 2022년 10월 25일부터 27일까지 진행되었던 아트랩 x SPAF 협력 프로그램의 일환으로 진행된

<메타버스로 확장된 공간을 통해보는 공연예술의 변화> 중, 강연내용을 글로 옮긴 것이다.

총 2회에 걸쳐 연재될 예정으로, 이번 호에서는 건축가에서 XR 공간 건축가로 변모하는 과정과 메타버스 공연 제작 사례를 소개한다.

아트랩 x SPAF 협력 프로그램강연 모습

필자는 극장 건축가(architect)에서 시작해 XR 공간 건축가(XR-chitect)라는 새로운 직업을 가지게 되었다. 이번 강연에서는 팬데믹 이후 새로운 공간으로 제시된 메타버스가 갖는 의미와 미래를 이야기해보고자 한다. 이를 통해 예술과 기술이 결합 되면서 생겨나는 다양한 갈등들과 이것이 어떻게 완전히 새로운 창작을 이끌어 낼 수 있는지 이야기할 것이다. 또한 예술을 기반으로 한 기업인 메타버스 공연 플랫폼 ‘헤브뉴(Heavenue)’와 XR 스튜디오 ‘에이질 렌즈(Agile Lens)’의 CEO로서 쌓은 10년간의 경험에 대해서도 이야기 해보려 한다.

2008년, 건축과 연극을 공부하는 학생으로서 마이클 바클레이(Michael Barclay) 교수와 만났다. 그와 런던을 방문해 여러 극장을 둘러보고 세계 최고의 배우들과 공연을 경험하며 느낀 점이 있다. 바로 극장 어디에 앉아 있는지에 따라 관객이 가지는 경험의 차이가 크다는 것이다. 무대와 가까운 좌석에 앉아 느끼는 특별한 경험. 즉, 배우의 내면 연기와 미묘한 뉘앙스를 체험할 수 있는 경험은 매우 소수에게만 제공된다. 필자는 기술이 이러한 경험을 어떻게 모든 관객에게 똑같이 느끼게 할 수 있을지에 대해 고민하게 되었다.

@Alex Coulombe

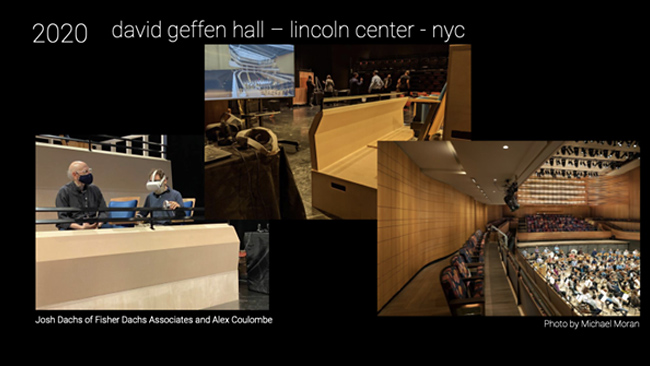

이후, 라파엘 비뇰리(Rafael Viñoly), 피셔닥스어소시에이츠(Fisher Dachs Associates) 등 유명한 건축사에서 롯데콘서트홀 등 극장 설계에 참여하게 되면서 건축과 가상현실을 융합시키는 경험을 하게 되었다. 기존에는 다이어그램을 통해 건축가의 디자인과 비전을 제안했는데, 2013년 가상현실(VR)이 건축가의 비전과 의도를 표현하는 데에 훌륭한 도구라는 것을 깨닫게 되었다. 동일한 아이디어라도 헤드셋을 쓰고 가상으로 구현된 공간 안에서 좌석 배치가 어떤 느낌을 주는지 직접 볼 수 있게 되자, 디자인 소통이 훨씬 효율적으로 가능해졌다. 극장이 완성되기 한참 전에 어떤 모습일지 가늠이 가능해진 것이다.

여기서 더 나아가, 최근 진행한 링컨센터 프로젝트의 경우에는 가상현실과 더불어 발코니, 레일, 좌석 등의 실제 모형을 만들어 촉감까지 활용함으로써 더욱 실제 경험에 가깝게 공간을 디자인하고 있다.

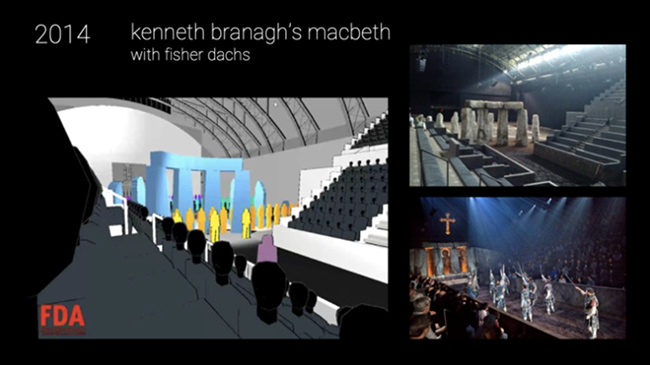

2020년 작업한 뉴욕 링컨센터 데이비드 게펜 홀(@alex coulombe)

새로운 기술을 다루다 보면 자신이 시작한 도구와 기술이 하나의 매체에만 적용되는 것이 아니라는 것을 알게 된다. 필자 역시 건축에서 사용했던 이러한 기술들을 활용해 프로덕션 디자인, 세트 디자인 등으로 영역을 확장해나갔다. 이제는 가상현실을 활용해 객석 배치, 무대디자인과 조명, 배우들의 동선까지도 사전시각화가 가능하며, 이는 실제 프로덕션의 확신을 더해주는 것은 물론 예산과 일정의 효율화를 가져온다.

케네스 브래넌 <맥베스> 사전시각화 모습과 실제 공연장면

가상현실이 공간 건축에 도움을 줄 수 있다는 점에서 시작했지만, 필자는 오히려 현실세계의 한계를 고려할 필요 없는 가상세계와 경험 구축에 더 관심을 가지게 되었다. 물리적으로 같은 공간에 있지 않더라도 관객들과 가상공간에서 그 연결을 유지하는 것이다. 그 결과, 메타버스 공연 플랫폼인 ‘헤브뉴(Heaveue)’를 설립하게 되었다.

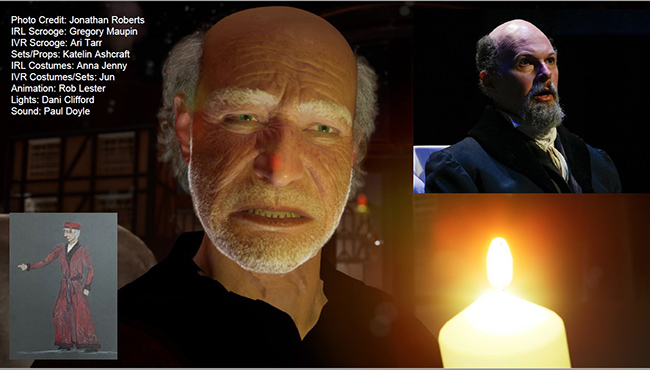

<크리스마스 캐롤(2021)>은 극장 시연과 VR 작품으로 각각 제작된 작품으로, 미국 루이빌의 액터스시어터(Actors Theatre of Louisville)와 협업으로 제작되었다. VR 작품은 현실과 동일한 부분도 있지만, 가상공간에서만 구현 가능한 부분과 관객이 극에 직접 참여해 극의 진행을 돕는 것을 고려하여 제작하였다.

<크리스마스캐롤> VR 장면 및 실제 연기 장면

가상현실 작품의 경우, 현실에서 쉽게 구현하기 어려운 것을 표현해 낼 수 있다. 예를 들면 실제 극장에 유령의 모습을 투사하기 위해서는 스크린 크기에 맞추어야 하지만, 가상현실에서는 스케일(크기)을 얼마든지 조정할 수 있고 예산 절감에도 큰 효과가 있다.

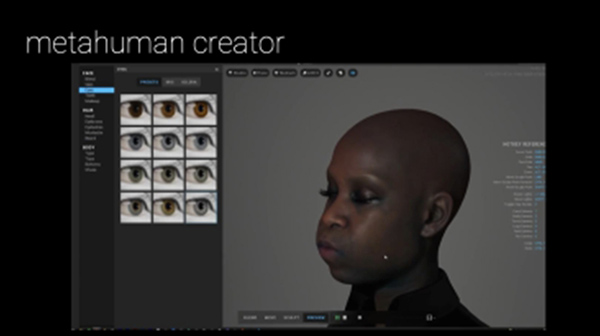

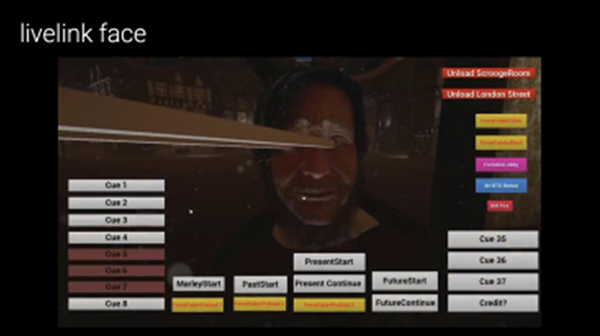

이 작품의 경우 언리얼엔진(Unreal Engine) 메타휴먼(Meta Human)과 페이스/모션캡처를 활용했고, 관객과 인터랙티브를 염두에 두고 제작하였다. 이전과 가장 큰 차이점은 기존의 소셜 VR 플랫폼에서 불가능했던 배우의 뉘앙스와 표현력전달이 적은 예산으로 가능해졌다는 사실이다. 우리는 닐 스티븐슨의 책 <다이아몬드 시대>에서 영감을 받아 메타버스 속 인터랙티브 배우를 ‘랙터(Ractor)’라고 부르기로 했는데, 랙터인 아리 탈(Ari Tarr)은 모션캡처 수트를 입고 자신의 집 거실에서 연기를 하고, 프로덕션 팀과 로버트 베리 플레밍(Robert Berry Fleming) 감독은 가상공간에서 장면을 디렉팅하며 마치 극장에서 리허설을 하는 것처럼 준비할 수 있었다. 무대와 의상 디자인이 완성되기 전 실시간 리허설을 하면서 문제점을 미리 발견하고, 이에 따른 장비와 해결방안을 예산에 맞춰 사전에 마련함으로써 효율적인 작업이 가능했다.

메타휴먼과 페이스캡처 프로그램(라이브링크 페이스)

작품의 주요 요소 중 하나인 인터랙티브를 구현하기 위해서는 강력한 클라우드 컴퓨터가 필요하다. 실제 클라우드 컴퓨터는 매우 비싸지만 지금은 이러한 클라우드 컴퓨터를 시간별로 대여할 수 있다. 시간당 겨우 몇 달러 정도 지불하면 공연을 할 수 있는 것이다. 작품에 사용된 소프트웨어인 언리얼 엔진 메타휴먼은 무료로 사용이 가능하다. 웹 브라우저 상에서 아주 높은 수준의 섬세한 디지털 캐릭터를 만들 수 있다.

이처럼 클라우드 컴퓨터와 메타휴먼을 활용하여 표현력이 좋은 디지털 휴먼을 제작하고, 페이스/모션캡처를 활용해 연기의 아주 세세한 부분까지도 캡처하여 매우 저렴한 예산으로 완성도 높은 작품을 제작할 수 있게 되었다.

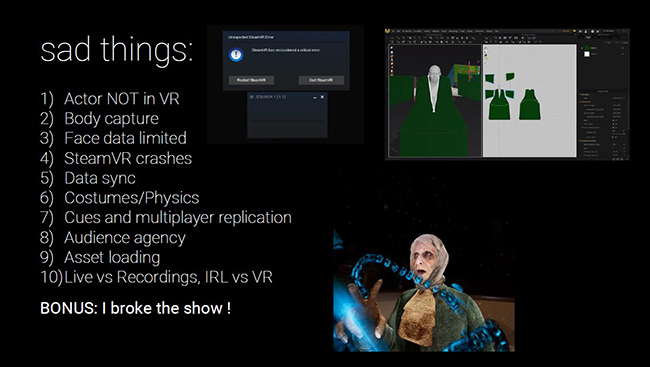

페이스/모션캡처, 메타휴먼, 클라우드 컴퓨터를 활용하면 짧은 시간 내에 높은 수준의 경험을 만들어 낼 수 있다. 하지만 이러한 작품을 위해서는 배우가 또 다른 방식의 연기방법을 익혀야 한다. 배우는 관객의 얼굴을 보고 소통하며 에너지를 얻지만, 제작과정에서는 관객과의 상호작용이 없음에도 있는 척을 해야 한다.

모션캡처수트의 사용에도 어려움이 있다. 로코코(Rokoko)나 엑센스(Xsense)와 같은 관성 모션 캡처 수트의 경우 망가지기 쉽고, 바이콘(Vicon) 옵티트랙(OptiTrack)같은 광학 추적 시스템(optical tracking system)의 경우 비용이 비싸다. 하지만 최근 무브 AI(Move.ai)나 래디컬 AI(Radical AI)같은 회사들이 수트, 도트 없이 카메라만 가지고도 캡처가 가능한 기술을 상당한 수준으로 끌어올려 기대를 모으고 있다.

다음으로 관객의 주체성과 자유(Audience Agency)에 대한 고민도 있다. 어떠한 경험을 제작할 때 관객이 어떠한 행동까지 가능한지를 설정하는 것이다.

마지막으로 가상공연을 제작할 때는 무엇을 라이브로 할지, 녹화된 영상을 사용할지, AI로 사용할지 등을 결정해야 한다. 사전 녹화는 안정성이 높지만 재생 후에는 되돌릴 수 없고, 라이브는 오작동이 될 수 있고, AI의 경우 설정한 대로 반응하지 않을 수 있다. <크리스마스 캐롤>을 제작하면서 배우들이 서로 떨어진 공간에서 호흡을 맞춰 연기를 할 때 시간 지연 등이 발생해 기술적으로 구현이 어렵다는 것을 알게 되었다. 때문에 일부 장면은 사전녹화를 사용하고, 일부는 라이브를 사용했으나 이를 적절히 활용해 관객은 전체 공연을 라이브라고 느꼈다. 이는 공연을 제작하는 입장에서 안정적인 운영을 가능하게 한다.

이 외에도, 위와 같은 부분들을 생각해보기를 권한다.

이미 설명한 라이브-사전녹화 외에도, 참여자 맞춤형 경험을 제공할지(싱글플레이어), 멀티플레이어로 만들어 주변의 다른 관객의 존재감을 느끼게 할 것인지를 정해야 한다. 또 멀티플레이어에서도 관객 간 상호작용을 할지, 배우와 상호작용을 할지 등 관객 주체성의 수준에 대한 결정이 필요하다.

구현 수준에 대한 고민도 필요하다. 실사의 느낌을 주도록 만든다면 보기에도 좋고 강력한 클라우드 컴퓨터를 사용해 배우의 연기를 활용하는 등 그 이점을 최대화 할 수 있다. 하지만 ‘불쾌한 골짜기(uncanny valley)’로 인해 불편하고 불안감을 줄지도 모른다. 반면 실사의 느낌보다 더 추상적이고 만화 같은 캐릭터를 활용하는 것이 오히려 매력을 느끼게 할 수 있다.

그 외에 관객이 어느 정도의 상호반응성을 가질 것인지에 대한 고려도 필요하다. 관객이 실제 극장과 같이 가만히 앉아 극을 경험하는 것이 좋을지, 또는 참여를 하게 해야 하는지를 생각해보아야 한다. 일부 관객은 이러한 참여를 불편하게 느낄 수도 있다.

마지막으로 최첨단 기술을 활용한 작품 제작은 안정성이 떨어질 수 있다. 필자 역시 작품 초연 날, 프로그램을 잘못 설정해 공연을 아예 볼 수 없게 되기도 했다. 현실 속에서는 실연의 실패에 엄청난 잘못이 필요하지만 가상공간에서는 한 번의 실수로 공연이 완전히 망가지기도 한다.

뉴테크놀로지(XR)를 기반으로 가상공간에서 공연을 제작하는 알렉스는 XR스튜디오 ‘에이질 렌즈(Aglie Lens)’의 공동 창업자이자 크리에이티브 디렉터이며 메타버스에서 공연자와 청중을 연결하는 클라우드 플랫폼 ‘헤브뉴(Heavenue)’의 CEO다. 브로드웨이 테크 엑셀러레이터로 활동하며 VR 퍼포먼스를 주제로 다양한 현장에서 강의를 진행하고 있으며, 공연예술에 활용되고 있는 게임엔진 에픽 게임즈 언리얼 엔진 교육 공인파트너, Unity 3D VR 인스트럭터로도 활동 중이다.

- 활동내역 : XR공연 [A Christmas Carol], 베니스 비엔날레 최초 VR공연 [Loveseat]제작 및 라이브 VR축제 ‘OnBoardXR’ 등과 협력, [Performing for Motion Capture: A Guide for Practitioners] 컨트리뷰터